发布时间: 2018-01-09 00:33:38

目前,Spark生态系统已经发展成为一个包含多个子项目的集合,其中包含SparkSQL、Spark Streaming、GraphX、MLlib等子项目,Spark是基于内存计算的大数据并行计算框架。Spark基于内存计算,提高了在大数据环境下数据处理的实时性,同时保证了高容错性和高可伸缩性,允许用户将Spark部署在大量廉价硬件之上,形成集群。Spark得到了众多大数据公司的支持,这些公司包括Hortonworks、IBM、Intel、Cloudera、MapR、Pivotal、百度、阿里、腾讯、京东、携程、优酷土豆。当前百度的Spark已应用于凤巢、大搜索、直达号、百度大数据等业务;阿里利用GraphX构建了大规模的图计算和图挖掘系统,实现了很多生产系统的推荐算法;腾讯Spark集群达到8000台的规模,是当前已知的世界上较大的Spark集群。

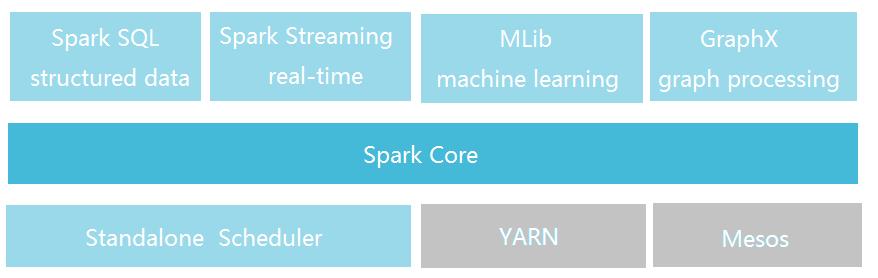

Spark Core:

包含Spark的基本功能,包含任务调度,内存管理,容错机制等

内部定义了RDDs(弹性分布式数据集)

提供了很多APIs来创建和操作这些RDDs

应用场景,为其他组件提供底层的服务

Spark SQL:

是Spark处理结构化数据的库,就像Hive SQL,Mysql一样

应用场景,企业中用来做报表统计

Spark Streaming:

是实时数据流处理组件,类似Storm

Spark Streaming提供了API来操作实时流数据

应用场景,企业中用来从Kafka接收数据做实时统计

MLlib:

一个包含通用机器学习功能的包,Machine learning lib

包含分类,聚类,回归等,还包括模型评估和数据导入。

MLlib提供的上面这些方法,都支持集群上的横向扩展。

应用场景,机器学习。

Graphx:

是处理图的库(例如,社交网络图),并进行图的并行计算。

像Spark Streaming,Spark SQL一样,它也继承了RDD API。

它提供了各种图的操作,和常用的图算法,例如PangeRank算法。

应用场景,图计算。

Cluster Managers:

就是集群管理,Spark自带一个集群管理是单独调度器。

常见集群管理包括Hadoop YARN,Apache Mesos

基于MapReduce的计算引擎通常会将中间结果输出到磁盘上,进行存储和容错。

出于任务管道承接的,考虑,当一些查询翻译到MapReduce任务时,往往会产生多个Stage,而这些串联的Stage又依赖于底层文件系统(如HDFS)来存储每一个Stage的输出结果HadoopSpark Spark是MapReduce的替代方案,而且兼容HDFS、Hive,可融入Hadoop的生态系统,以弥补MapReduce的不足。

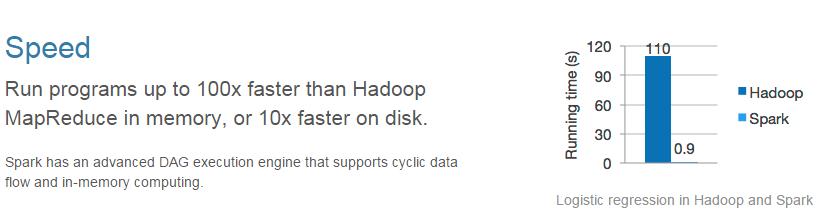

Spark特点:

快:与Hadoop的MapReduce相比,Spark基于内存的运算要快100倍以上,基于硬盘的运算也要快10倍以上。Spark实现了高效的DAG执行引擎,可以通过基于内存来高效处理数据流

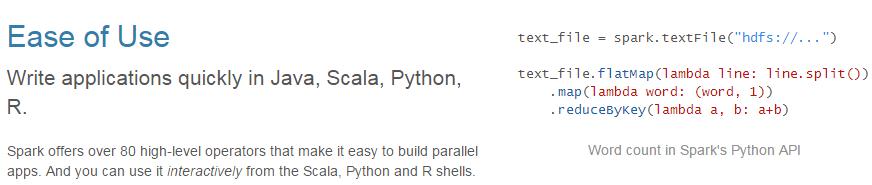

易用:

Spark支持Java、Python和Scala的API,还支持超过80种高级算法,使用户可以快速构建不同的应用。而且Spark支持交互式的Python和Scala的shell,可以非常方便地在这些shell中使用Spark集群来验证解决问题的方法。

通用:

Spark提供了统一的解决方案。Spark可以用于批处理、交互式查询(Spark SQL)、实时流处理(Spark Streaming)、机器学习(Spark MLlib)和图计算(GraphX)。这些不同类型的处理都可以在同一个应用中无缝使用。Spark统一的解决方案非常具有吸引力,毕竟任何公司都想用统一的平台去处理遇到的问题,减少开发和维护的人力成本和部署平台的物力成本。

兼容性:

Spark可以非常方便地与其他的开源产品进行融合。比如,Spark可以使用Hadoop的YARN和Apache Mesos作为它的资源管理和调度器,并且可以处理所有Hadoop支持的数据,包括HDFS、HBase和Cassandra等。这对于已经部署Hadoop集群的用户特别重要,因为不需要做任何数据迁移就可以使用Spark的强大处理能力。Spark也可以不依赖于第三方的资源管理和调度器,它实现了Standalone作为其内置的资源管理和调度框架,这样进一步降低了Spark的使用门槛,使得所有人都可以非常容易地部署和使用Spark。此外,Spark还提供了在EC2上部署Standalone的Spark集群的工具。

Spark集群安装:

机器部署

准备两台以上Linux服务器,安装好JDK1.8

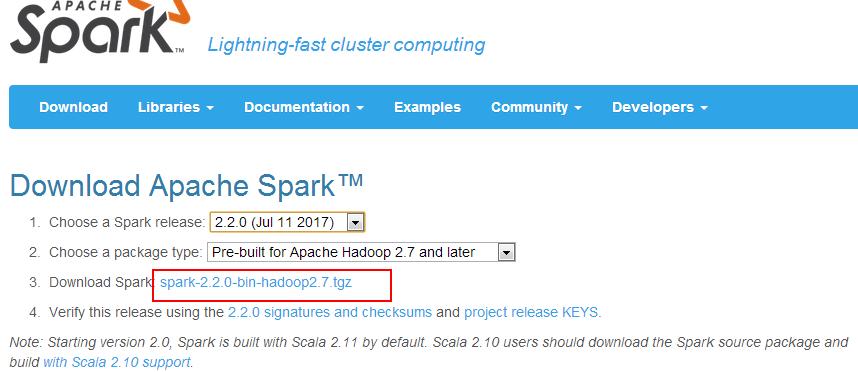

下载Spark安装包

http://mirrors.tuna.tsinghua.edu.cn/apache/spark/spark-2.2.0/spark-2.2.0-bin-hadoop2.7.tgz

上传解压安装包

上传spark-2.2.0-bin-hadoop2.7.tgz安装包到Linux上

解压安装包到指定位置

[hadoop@hdp01 ~]$ tar zxvf spark-2.2.0-bin-hadoop2.7.tgz -C apps

[hadoop@hdp01 ~]$ cd apps

[hadoop@hdp01 apps]$ mv spark-2.2.0-bin-hadoop2.7 spark

配置Spark:

进入到Spark安装目录

[hadoop@hdp01 apps]$ cd spark/

进入conf目录并重命名并修改spark-env.sh.template文件

[hadoop@hdp01 apps]$cd conf/

[hadoop@hdp01 apps]$mv spark-env.sh.template spark-env.sh

[hadoop@hdp01 apps]$vi spark-env.sh

在该配置文件中添加如下配置

export JAVA_HOME=/opt/jdk1.8.0_121

export SPARK_MASTER_IP=hdp08

export SPARK_MASTER_PORT=7077

保存退出

重命名并修改slaves.template文件

[hadoop@hdp01 conf]$ mv slaves.template slaves

[hadoop@hdp01 conf]$ vi slaves

在该文件中添加子节点所在的位置(Worker节点)

hdp05

hdp06

hdp07

保存退出

将配置好的Spark拷贝到其他节点上

[hadoop@hdp01 spark]$ scp -r spark hadoop@hdp05:/home/hadoop/apps

[hadoop@hdp01 spark]$ scp -r spark hadoop@hdp06:/home/hadoop/apps

[hadoop@hdp01 spark]$ scp -r spark hadoop@hdp06:/home/hadoop/apps

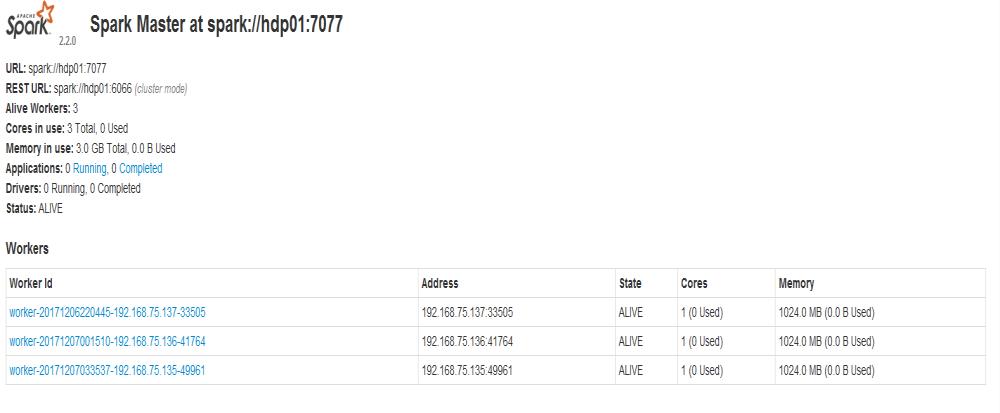

Spark集群配置完毕,目前是1个Master,3个Work,在hdp08上启动Spark集群

[hadoop@hdp01 spark]$ sbin/start-all.sh

启动后执行jps命令,主节点上有Master进程,其他子节点上有Work进行,登录Spark管理界面查看集群状态(主节点):http://hdp08:8080/

到此为止,Spark集群安装完毕,但是有一个很大的问题,那就是Master节点存在单点故障,要解决此问题,就要借助zookeeper,并且启动至少两个Master节点来实现高可靠,配置方式比较简单:

Spark集群规划:hdp01,hdp02是Master;hdp05,hdp06,hdp07是Worker

安装配置zk集群,并启动zk集群

停止spark所有服务,修改配置文件spark-env.sh,在该配置文件中删掉SPARK_MASTER_IP并添加如下配置

export SPARK_DAEMON_JAVA_OPTS="-Dspark.deploy.recoveryMode=ZOOKEEPER -Dspark.deploy.zookeeper.url=hdp05,hdp06,hdp07 - Dspark.deploy.zookeeper.dir=/spark"

1.在hdp01节点上修改slaves配置文件内容指定worker节点

2.在hdp01上执行sbin/start-all.sh脚本,然后在hdp02上执行sbin/start-master.sh启动第二个Master

执行Spark程序:

spark-shell是Spark自带的交互式Shell程序,方便用户进行交互式编程,用户可以在该命令行下用scala编写spark程序。

启动spark shell:

bin/spark-shell \

--master spark://hdp08:7077 \

--executor-memory 1g \

--total-executor-cores 2

参数说明:

--master spark://node1.togogo.cn:7077 指定Master的地址

--executor-memory 512M 指定每个worker可用内存为512M,也可以指定为2g

--total-executor-cores 2 指定整个集群使用的cup核数为2个

注意:

如果启动spark shell时没有指定master地址,但是也可以正常启动spark shell和执行spark shell中的程序,其实是启动了spark的local模式,该模式仅在本机启动一个进程,没有与集群建立联系。

Spark Shell中已经默认将SparkContext类初始化为对象sc。用户代码如果需要用到,则直接应用sc即可

在spark shell中编写WordCount程序:

1.首先启动hdfs

2.向hdfs上传一个文件到hdfs://hdp01:9000/ README.md

3.在spark shell中用scala语言编写spark程序

sc.textFile("hdfs://hdp08:9000/spark/README.md").flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).saveAsTextFile("hdfs://hdp08:9000/spark/out")

4.使用hdfs命令查看结果

[hadoop@hdp01 spark]$ hadoop fs -ls /spark/out

说明:

sc是SparkContext对象,该对象时提交spark程序的入口

textFile(hdfs://hdp01:9000/spark/README.md)是hdfs中读取数据

flatMap(_.split(" "))先map在压平

map((_,1))将单词和1构成元组

reduceByKey(_+_)按照key进行reduce,并将value累加

saveAsTextFile("hdfs://hdp01:9000/spark/out")将结果写入到hdfs中

注意一:scala中的下划线含义

1、 作为“通配符”,类似Java中的*。如import scala.math._

2、 _*作为一个整体,告诉编译器你希望将某个参数当作参数序列处理!例如val s = sum(1 to 5:_*)就是将1 to 5当作参数序列处理。

3、 指代一个集合中的每个元素。例如我们要在一个Array a中筛出偶数,并乘以2,可以用以下办法:

a.filter(_%2==0).map(2*_)。

又如要对缓冲数组ArrayBuffer b排序,可以这样:

val bSorted = b.sorted(_

4、 在元组中,可以用方法_1, _2, _3访问组员。如a._2。其中句点可以用空格替代。

5、 使用模式匹配可以用来获取元组的组员,例如

val (first, second, third) = t

但如果不是所有的部件都需要,那么可以在不需要的部件位置上使用_。比如上一例中val (first, second, _) = t

6、 还有一点,下划线_代表的是某一类型的默认值。

对于Int来说,它是0。

对于Double来说,它是0.0

对于引用类型,它是null。

注意二:map()与flatMap()区别

aap()是将函数用于RDD中的每个元素,将返回值构成新的RDD。

flatmap()是将函数应用于RDD中的每个元素,将返回的迭代器的所有内容构成新的RDD,这样就得到了一个由各列表中的元素组成的RDD,而不是一个列表组成的RDD。

有些拗口,看看例子就明白了。

val rdd = sc.parallelize(List("coffee panda","happy panda","happiest panda party"))

输入

rdd.map(x=>x).collect

结果

res9: Array[String] = Array(coffee panda, happy panda, happiest panda party)

输入

rdd.flatMap(x=>x.split(" ")).collect

结果

res8: Array[String] = Array(coffee, panda, happy, panda, happiest, panda, party)

flatMap说明白就是先map然后再flat,再来看个例子

val rdd1 = sc.parallelize(List(1,2,3,3))

scala> rdd1.map(x=>x+1).collect

res10: Array[Int] = Array(2, 3, 4, 4)

scala> rdd1.flatMap(x=>x.to(3)).collect

res11: Array[Int] = Array(1, 2, 3, 2, 3, 3, 3)

---------------------------------------------------------------------------------------------------------------------------

var li=List(1,2,3,4)

var res =li.flatMap(x=> x match {

case 3 => List(3.1,3.2)

case _ =>List(x*2)

})

println(res)

li= List(1,2,3,4)

var res2 =li.map(x=> x match {

case 3 =>List(3.1,3.2)

case _ =>x*2

})

println(res2)

//output=>

List(2,4, 3.1,3.2, 8)

List(2,4, List(3.1,3.2), 8)

Program exited.

这个过程就像是先 map, 然后再将 map 出来的这些列表首尾相接 (flatten).

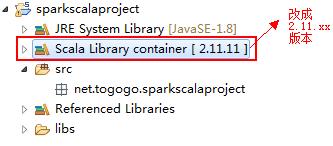

在IDEA中编写WordCount程序:

spark shell仅在测试和验证我们的程序时使用的较多,在生产环境中,通常会在IDE中编制程序,然后打成jar包,然后提交到集群。

2.新建一个scala class,类型为Object

3.编写spark程序

package net.togogo.scalasparkdemo

import org.apache.spark.SparkConf

import org.apache.spark.SparkContext

object WordCount {

def main(args: Array[String]) {

//创建SparkConf()并设置App名称

val conf = new SparkConf().setAppName("WC")

//创建SparkContext,该对象是提交spark App的入口

val sc = new SparkContext(conf)

//使用sc创建RDD并执行相应的transformation和action

sc.textFile(args(0)).flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _, 1).sortBy(_._2, false).saveAsTextFile(args(1))

//停止sc,结束该任务

sc.stop()

}

}

4.导出jar包

5.首先启动hdfs和Spark集群

启动hdfs

start-dfs.sh

启动spark

/sbin/start-all.sh

6.使用spark-submit命令提交Spark应用(注意参数的顺序)

/home/hadoop/apps/spark/bin/spark-submit \

--class net.togogo.sparkscalaproject.WordCountDemo \

--master spark://hdp08:7077 \

--executor-memory 1G \

--total-executor-cores 2 \

/home/hadoop/wcdemo.jar \

hdfs://hdp08:9000/work/README.md \

hdfs://hdp08:9000/work/out3

查看程序执行结果

上一篇: {大数据}RDD分布式数据集

下一篇: {大数据}hdfs的工作机制